2024-07-08

한어Русский языкEnglishFrançaisIndonesianSanskrit日本語DeutschPortuguêsΕλληνικάespañolItalianoSuomalainenLatina

ChatGPT:n julkaisusta kuluneiden lähes 18 kuukauden aikana kyberrikolliset ovat pystyneet hyödyntämään generatiivista tekoälyä hyökkäyksiin. OpenAI:n sisältökäytännössä on rajoituksia haitallisen sisällön luomisen estämiseksi. Vastauksena,Hyökkääjät ovat luoneet omia generatiivisia tekoälyalustoja, kuten WormGPT ja FraudGPT, ja he ovat myös kertoneet, kuinka nämä rajoitukset voidaan ohittaa "jailbreak" ChatGPT:lle.

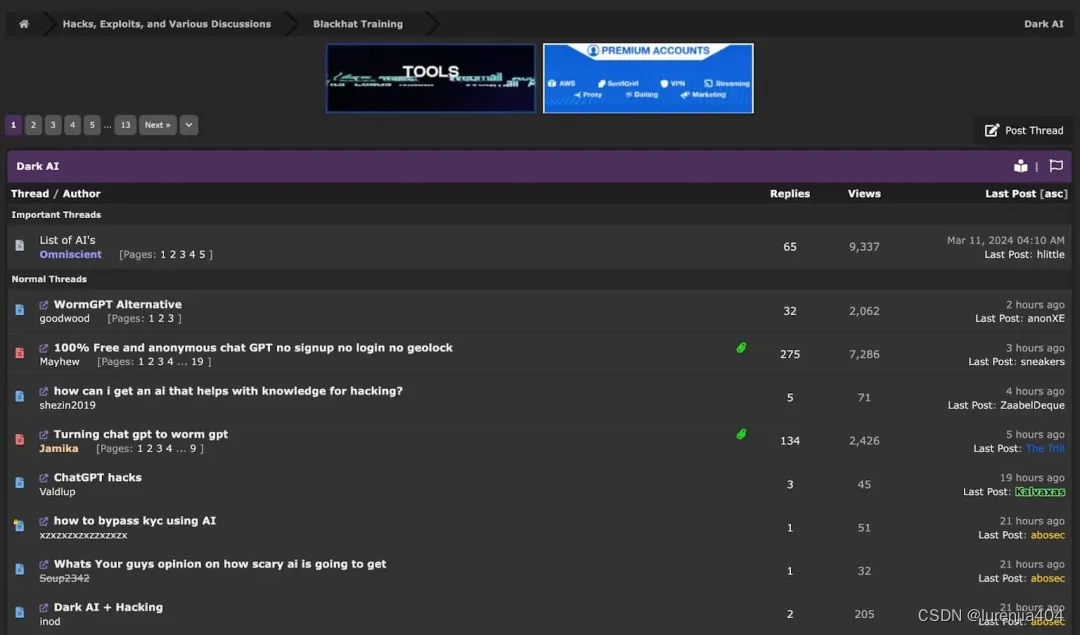

Itse asiassa on olemassa kokonaisia kyberrikollisfoorumeita, joissa keskustellaan siitä, kuinka tekoälyä voidaan käyttää laittomiin tarkoituksiin.

Kokonaiset kyberrikollisuusfoorumit keskustelevat "tummasta tekoälystä"