informasi kontak saya

Surat[email protected]

2024-07-08

한어Русский языкEnglishFrançaisIndonesianSanskrit日本語DeutschPortuguêsΕλληνικάespañolItalianoSuomalainenLatina

Dalam waktu hampir 18 bulan sejak ChatGPT dirilis, penjahat dunia maya telah mampu memanfaatkan AI generatif untuk melakukan serangan. OpenAI menerapkan batasan dalam kebijakan kontennya untuk mencegah pembuatan konten berbahaya. Sebagai tanggapan,Penyerang telah membuat platform AI generatif mereka sendiri, seperti WormGPT dan FraudGPT, dan mereka juga telah berbagi cara melewati batasan ini untuk melakukan "jailbreak" ChatGPT.

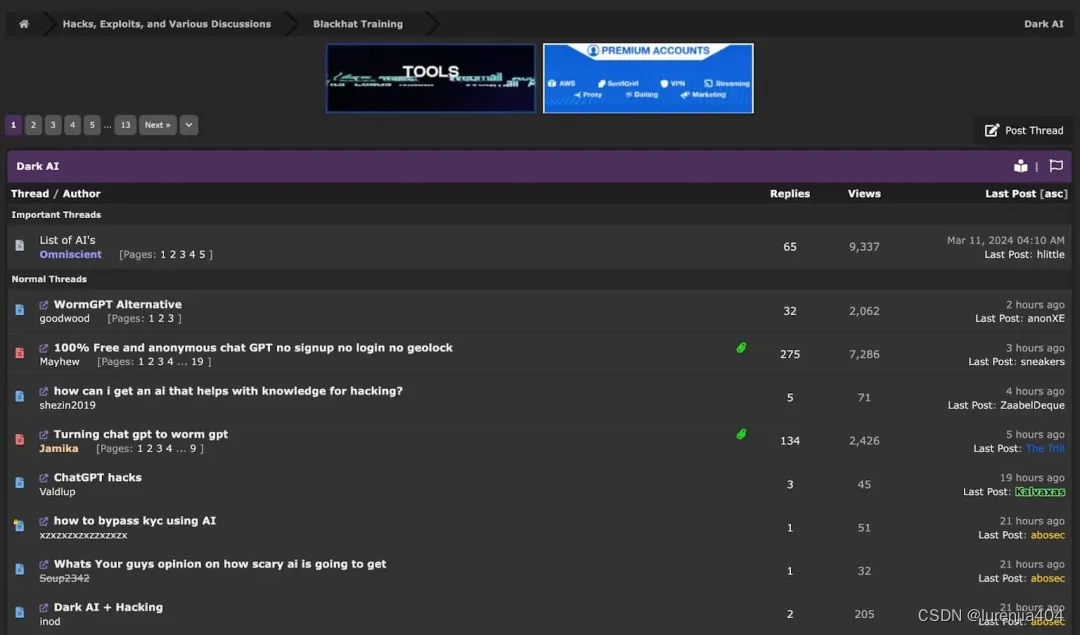

Faktanya, ada banyak forum penjahat dunia maya yang membahas bagaimana AI dapat digunakan untuk tujuan ilegal.

Seluruh forum kejahatan dunia maya mendiskusikan “AI gelap”