私の連絡先情報

郵便メール:

2024-07-12

한어Русский языкEnglishFrançaisIndonesianSanskrit日本語DeutschPortuguêsΕλληνικάespañolItalianoSuomalainenLatina

PNN (Probabilistic Neural Network、確率的ニューラル ネットワーク) は、主に分類問題を解決するために使用される、確率理論に基づくニューラル ネットワーク モデルです。 PNN は、1993 年に Makovsky と Masikin によって初めて提案されました。これは、非常に効果的な分類アルゴリズムです。

PNN の原理は、次の手順のように簡単に要約できます。

PNN には次のような特徴があります。

一般に、PNN は非常に効果的な分類アルゴリズムであり、画像認識、テキスト分類など、さまざまな分野の分類問題に適しています。

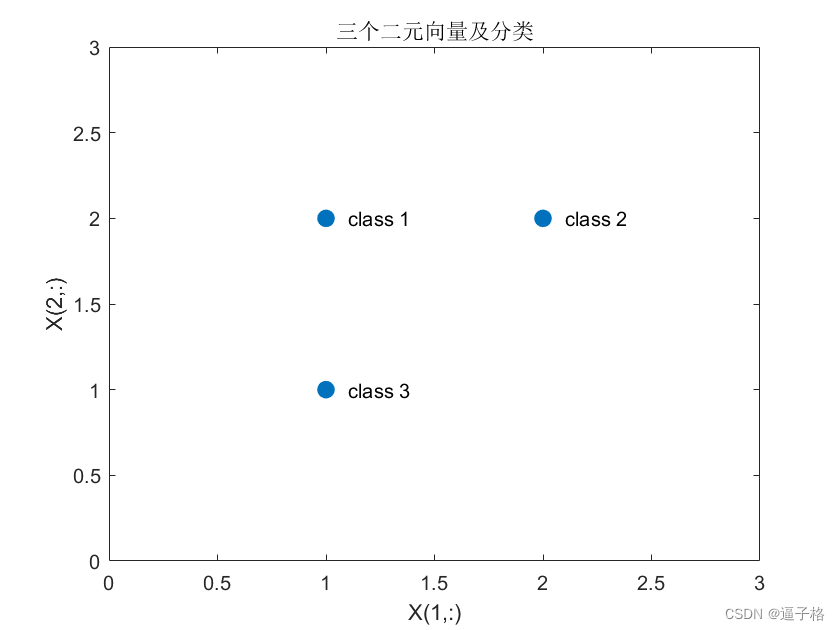

3 つのバイナリ入力ベクトル X とそれらに関連するクラス Tc があります。

これらのベクトルを正しく分類するために確率的ニューラル ネットワークを作成します。

確率的ニューラル ネットワーク (PNN) は、分類問題に適した放射基底ネットワークです。

net = newpnn(P,T,spread)% は、2 つまたは 3 つのパラメーターを受け入れ、新しい確率的ニューラル ネットワークを返します。

ぷ:Q 入力ベクトルの r × Q 行列

た:Q 個のターゲット クラス ベクトルの s × Q 行列

広める: 伝播動径基底関数の拡張 (デフォルト = 0.1)

拡散がゼロに近い場合、ネットワークは最近傍分類子として機能します。スケーリングが大きくなると、設計されたネットワークでは、いくつかの近くの設計ベクトルが考慮されます。

[Y,Xf,Af] = sim(net,X,Xi,Ai,T) ネット:ネットワーク

X: ネットワークへの入力

Xi: 初期入力遅延条件 (デフォルト = 0)

Ai: 初期層遅延条件 (デフォルト = 0)

T: ネットワークターゲット (デフォルト = 0)

- X = [1 2; 2 2; 1 1]';

- Tc = [1 2 3];

- figure(1)

- plot(X(1,:),X(2,:),'.','markersize',30)

- for i = 1:3, text(X(1,i)+0.1,X(2,i),sprintf('class %g',Tc(i))), end

- axis([0 3 0 3])

- title('三个二元向量及分类')

- xlabel('X(1,:)')

- ylabel('X(2,:)')

ターゲット クラス インデックス Tc をベクトル T に変換します

NEWPNN を使用して確率的ニューラル ネットワークを設計する

SPREAD の値は 1 です。これは、これが入力ベクトル間の一般的な距離であるためです。

- T = ind2vec(Tc);

- spread = 1;

- net = newpnn(X,T,spread);

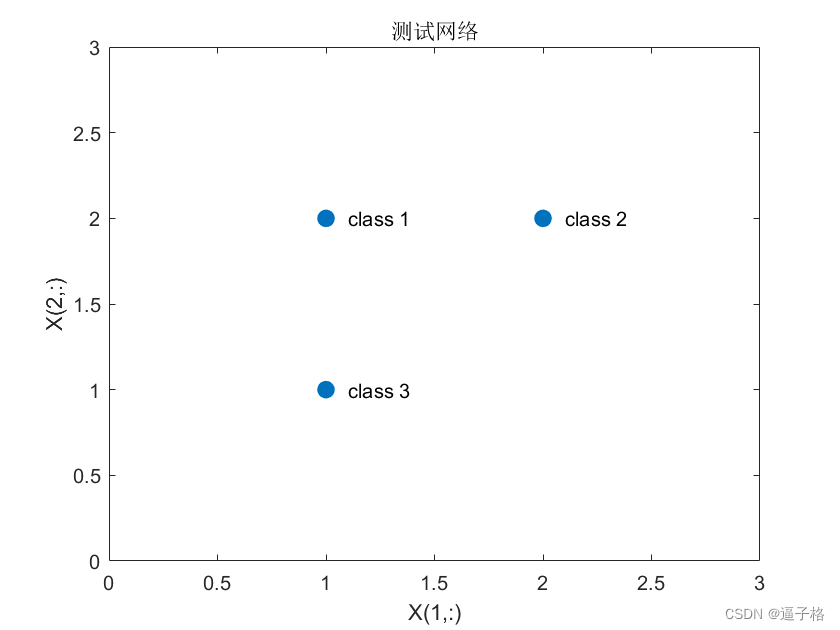

- %测试网络

- %基于输入向量测试网络。通过对网络进行仿真并将其向量输出转换为索引来实现目的。

- Y = net(X);

- Yc = vec2ind(Y);

- figure(2)

- plot(X(1,:),X(2,:),'.','markersize',30)

- axis([0 3 0 3])

- for i = 1:3,text(X(1,i)+0.1,X(2,i),sprintf('class %g',Yc(i))),end

- title('测试网络')

- xlabel('X(1,:)')

- ylabel('X(2,:)')

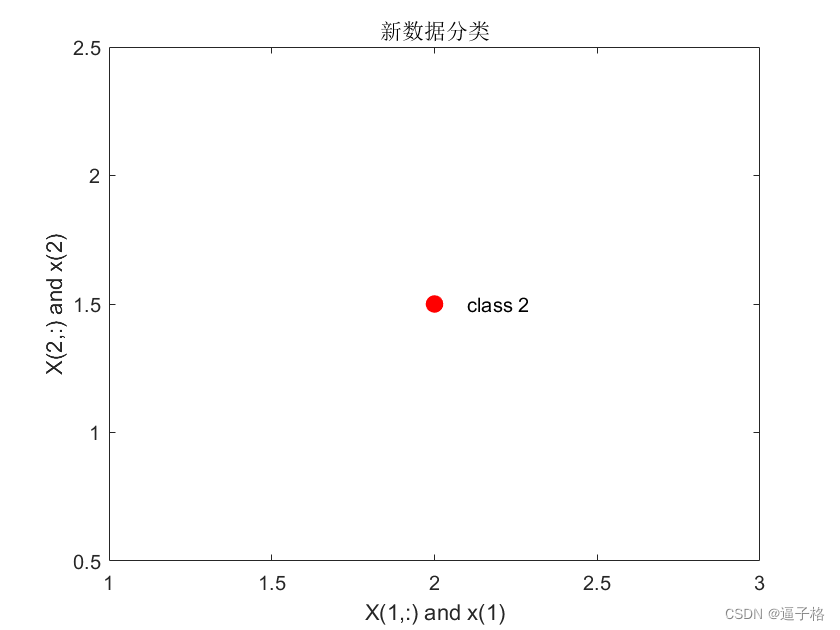

- x = [2; 1.5];

- y = net(x);

- ac = vec2ind(y);

- hold on

- figure(3)

- plot(x(1),x(2),'.','markersize',30,'color',[1 0 0])

- text(x(1)+0.1,x(2),sprintf('class %g',ac))

- hold off

- title('新数据分类')

- xlabel('X(1,:) and x(1)')

- ylabel('X(2,:) and x(2)')

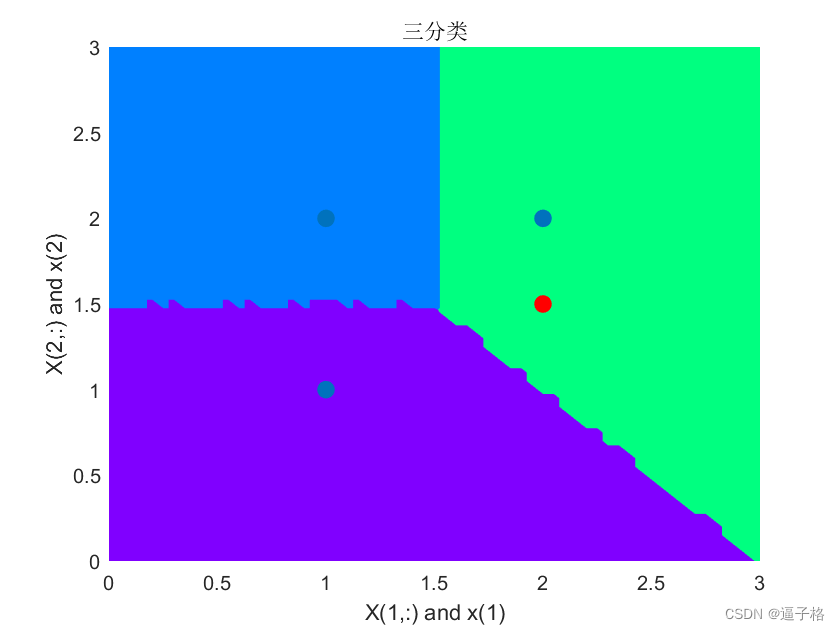

3つのカテゴリーに分けられる

- x1 = 0:.05:3;

- x2 = x1;

- [X1,X2] = meshgrid(x1,x2);

- xx = [X1(:) X2(:)]';

- yy = net(xx);

- yy = full(yy);

- m = mesh(X1,X2,reshape(yy(1,:),length(x1),length(x2)));

- m.FaceColor = [0 0.5 1];

- m.LineStyle = 'none';

- hold on

- m = mesh(X1,X2,reshape(yy(2,:),length(x1),length(x2)));

- m.FaceColor = [0 1.0 0.5];

- m.LineStyle = 'none';

- m = mesh(X1,X2,reshape(yy(3,:),length(x1),length(x2)));

- m.FaceColor = [0.5 0 1];

- m.LineStyle = 'none';

- plot3(X(1,:),X(2,:),[1 1 1]+0.1,'.','markersize',30)

- plot3(x(1),x(2),1.1,'.','markersize',30,'color',[1 0 0])

- hold off

- view(2)

- title('三分类')

- xlabel('X(1,:) and x(1)')

- ylabel('X(2,:) and x(2)')

確率的ニューラル ネットワーク (PNN) は、パターン分類に使用される人工ニューラル ネットワークです。これはベイズの定理と混合ガウス モデルに基づいており、連続データや離散データを含むさまざまな種類のデータの処理に使用できます。 PNN は、分類問題を扱う際に従来のニューラル ネットワークよりも柔軟であり、より高い精度と一般化機能を備えています。

PNN の基本的な動作原理は、入力データ セットとサンプル セット内の各サンプルの間の類似性を計算し、その類似性に基づいて入力データを分類することです。 PNN は、入力層、パターン層、競合層、出力層の 4 つの層で構成されます。入力データはまず入力層を介してパターン層に渡され、次に競合層を介して類似度が計算され、最後に出力層で類似度に応じて分類されます。

Matlab では、関連するツールボックスを使用するか、自分でプログラムして PNN 分類を実装できます。まず、トレーニング データ セットとテスト データ セットを準備し、トレーニング データ セットを通じて PNN モデルをトレーニングする必要があります。トレーニングが完了したら、テスト データ セットを使用して PNN の分類パフォーマンスを評価し、予測を行うことができます。

全体として、PNN はさまざまな分類問題に適した強力な分類方法です。実際のアプリケーションでは、特定の問題に応じて適切な特徴とモデル パラメーターを選択して、分類パフォーマンスを向上させることができます。 Matlab は豊富なツールと関数サポートを提供し、PNN の実装と適用を容易にします。

- %% 基于概率神经网络(PNN)的分类(matlab)

- %此处有三个二元输入向量 X 和它们相关联的类 Tc。

- %创建 y 概率神经网络,对这些向量正确分类。

- %重要函数:NEWPNN 和 SIM 函数

- %% 数据集及显示

- X = [1 2; 2 2; 1 1]';

- Tc = [1 2 3];

- figure(1)

- plot(X(1,:),X(2,:),'.','markersize',30)

- for i = 1:3, text(X(1,i)+0.1,X(2,i),sprintf('class %g',Tc(i))), end

- axis([0 3 0 3])

- title('三个二元向量及分类')

- xlabel('X(1,:)')

- ylabel('X(2,:)')

- %% 基于设计输入向量测试网络

- %将目标类索引 Tc 转换为向量 T

- %用 NEWPNN 设计 y 概率神经网络

- % SPREAD 值 1,因为这是输入向量之间的 y 典型距离。

- T = ind2vec(Tc);

- spread = 1;

- net = newpnn(X,T,spread);

- %测试网络

- %基于输入向量测试网络。通过对网络进行仿真并将其向量输出转换为索引来实现目的。

- Y = net(X);

- Yc = vec2ind(Y);

- figure(2)

- plot(X(1,:),X(2,:),'.','markersize',30)

- axis([0 3 0 3])

- for i = 1:3,text(X(1,i)+0.1,X(2,i),sprintf('class %g',Yc(i))),end

- title('测试网络')

- xlabel('X(1,:)')

- ylabel('X(2,:)')

- %数据测试

- x = [2; 1.5];

- y = net(x);

- ac = vec2ind(y);

- hold on

- figure(3)

- plot(x(1),x(2),'.','markersize',30,'color',[1 0 0])

- text(x(1)+0.1,x(2),sprintf('class %g',ac))

- hold off

- title('新数据分类')

- xlabel('X(1,:) and x(1)')

- ylabel('X(2,:) and x(2)')

- %% 概率神经网络将输入空间分为三个类。

- x1 = 0:.05:3;

- x2 = x1;

- [X1,X2] = meshgrid(x1,x2);

- xx = [X1(:) X2(:)]';

- yy = net(xx);

- yy = full(yy);

- m = mesh(X1,X2,reshape(yy(1,:),length(x1),length(x2)));

- m.FaceColor = [0 0.5 1];

- m.LineStyle = 'none';

- hold on

- m = mesh(X1,X2,reshape(yy(2,:),length(x1),length(x2)));

- m.FaceColor = [0 1.0 0.5];

- m.LineStyle = 'none';

- m = mesh(X1,X2,reshape(yy(3,:),length(x1),length(x2)));

- m.FaceColor = [0.5 0 1];

- m.LineStyle = 'none';

- plot3(X(1,:),X(2,:),[1 1 1]+0.1,'.','markersize',30)

- plot3(x(1),x(2),1.1,'.','markersize',30,'color',[1 0 0])

- hold off

- view(2)

- title('三分类')

- xlabel('X(1,:) and x(1)')

- ylabel('X(2,:) and x(2)')

-

-

-