2024-07-12

한어Русский языкEnglishFrançaisIndonesianSanskrit日本語DeutschPortuguêsΕλληνικάespañolItalianoSuomalainenLatina

PNN (Probabilistic Neural Network, probabilistic neural network) संभाव्यतासिद्धान्ते आधारितं तंत्रिकाजालप्रतिरूपं भवति, यस्य उपयोगः मुख्यतया वर्गीकरणसमस्यानां समाधानार्थं भवति । पीएनएन प्रथमवारं १९९३ तमे वर्षे माकोव्स्की-मासिकिन्-इत्यनेन प्रस्तावितं ।इदं अतीव प्रभावी वर्गीकरण-एल्गोरिदम् अस्ति ।

पीएनएन-सिद्धान्तस्य संक्षेपेण निम्नलिखितपदार्थाः इति सारांशः कर्तुं शक्यते ।

पीएनएन इत्यस्य निम्नलिखितगुणाः सन्ति ।

सामान्यतया पीएनएन अतीव प्रभावी वर्गीकरण-एल्गोरिदम् अस्ति तथा च विभिन्नक्षेत्रेषु वर्गीकरणसमस्यानां कृते उपयुक्तः अस्ति, यथा चित्रपरिचयः, पाठवर्गीकरणं इत्यादिषु

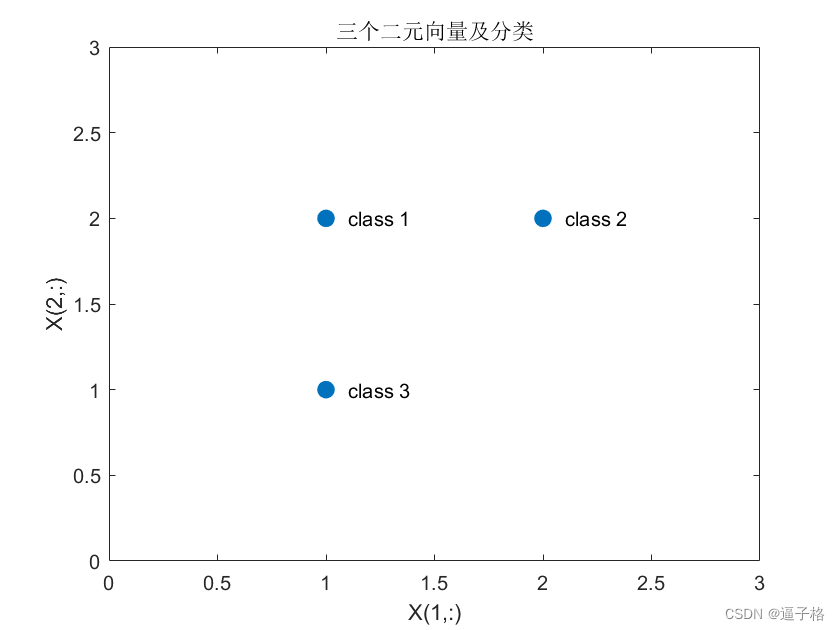

तत्र त्रयः द्विचक्रीयनिवेशसदिशाः X सन्ति तथा च तेषां सम्बद्धाः वर्गाः Tc ।

एतेषां सदिशानां सम्यक् वर्गीकरणार्थं संभाव्यतावादी तंत्रिकाजालं रचयन्तु ।

संभाव्यतावादी तंत्रिकाजालम् (PNN) वर्गीकरणसमस्यानां कृते उपयुक्तं रेडियल आधारजालम् अस्ति ।

net = newpnn(P,T,spread)% द्वौ वा त्रीणि वा पैरामीटर्स् स्वीकुर्वति तथा च नूतनं संभाव्यतावादीं तंत्रिकाजालं प्रत्यागच्छति ।

प : ९.Q इनपुट सदिशों के r × Q मैट्रिक्स

त: ९.Q लक्ष्य वर्ग सदिशों के s × Q मैट्रिक्स

विस्तीर्णम्: प्रसारित त्रिज्या आधारफलकानां विस्तारः (पूर्वनिर्धारितः = 0.1)

यदि प्रसारः शून्यस्य समीपे भवति तर्हि जालम् समीपस्थस्य प्रतिवेशिनः वर्गीकरणस्य कार्यं करोति । यदा स्केलिंग् बृहत् भवति तदा डिजाइनं कृतं जालं समीपस्थं कतिपयान् डिजाइन सदिशान् विचारयति ।

[Y,Xf,Af] = sim(net,X,Xi,Ai,T) net: जालम्

X: जालपुटे निवेशः

Xi: प्रारम्भिक इनपुट विलम्ब स्थिति (पूर्वनिर्धारित = 0)

ऐ: प्रारम्भिक स्तर विलम्ब स्थिति (पूर्वनिर्धारित = 0)

T: संजाल लक्ष्य (पूर्वनिर्धारित = 0) .

- X = [1 2; 2 2; 1 1]';

- Tc = [1 2 3];

- figure(1)

- plot(X(1,:),X(2,:),'.','markersize',30)

- for i = 1:3, text(X(1,i)+0.1,X(2,i),sprintf('class %g',Tc(i))), end

- axis([0 3 0 3])

- title('三个二元向量及分类')

- xlabel('X(1,:)')

- ylabel('X(2,:)')

लक्ष्यवर्गसूचकाङ्कः Tc सदिश T मध्ये परिवर्तयन्तु

y संभाव्यतावादी तंत्रिकाजालस्य डिजाइनं कर्तुं NEWPNN इत्यस्य उपयोगं कुर्वन्तु

SPREAD इत्यस्य मूल्यं 1 अस्ति यतोहि एतत् निवेशसदिशयोः मध्ये विशिष्टं दूरं भवति ।

- T = ind2vec(Tc);

- spread = 1;

- net = newpnn(X,T,spread);

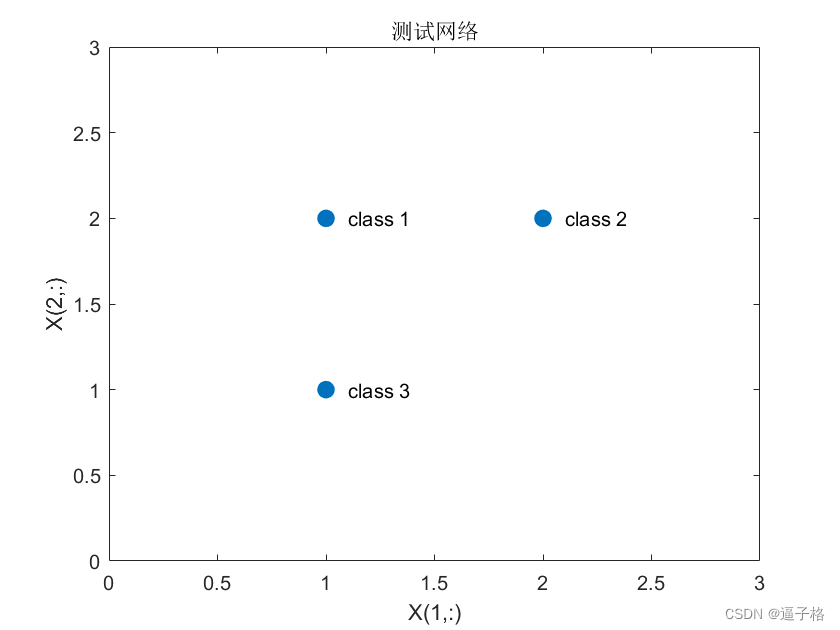

- %测试网络

- %基于输入向量测试网络。通过对网络进行仿真并将其向量输出转换为索引来实现目的。

- Y = net(X);

- Yc = vec2ind(Y);

- figure(2)

- plot(X(1,:),X(2,:),'.','markersize',30)

- axis([0 3 0 3])

- for i = 1:3,text(X(1,i)+0.1,X(2,i),sprintf('class %g',Yc(i))),end

- title('测试网络')

- xlabel('X(1,:)')

- ylabel('X(2,:)')

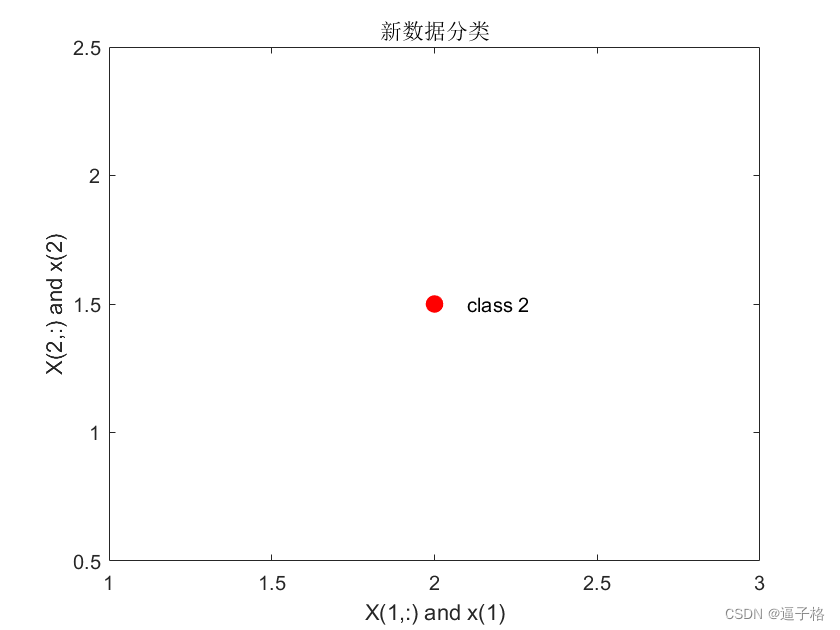

- x = [2; 1.5];

- y = net(x);

- ac = vec2ind(y);

- hold on

- figure(3)

- plot(x(1),x(2),'.','markersize',30,'color',[1 0 0])

- text(x(1)+0.1,x(2),sprintf('class %g',ac))

- hold off

- title('新数据分类')

- xlabel('X(1,:) and x(1)')

- ylabel('X(2,:) and x(2)')

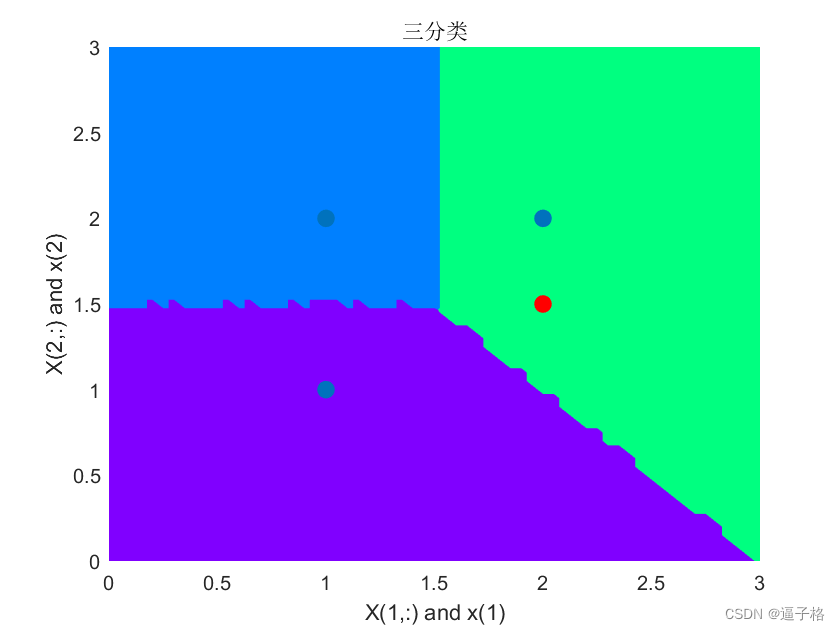

त्रयः वर्गाः विभक्ताः

- x1 = 0:.05:3;

- x2 = x1;

- [X1,X2] = meshgrid(x1,x2);

- xx = [X1(:) X2(:)]';

- yy = net(xx);

- yy = full(yy);

- m = mesh(X1,X2,reshape(yy(1,:),length(x1),length(x2)));

- m.FaceColor = [0 0.5 1];

- m.LineStyle = 'none';

- hold on

- m = mesh(X1,X2,reshape(yy(2,:),length(x1),length(x2)));

- m.FaceColor = [0 1.0 0.5];

- m.LineStyle = 'none';

- m = mesh(X1,X2,reshape(yy(3,:),length(x1),length(x2)));

- m.FaceColor = [0.5 0 1];

- m.LineStyle = 'none';

- plot3(X(1,:),X(2,:),[1 1 1]+0.1,'.','markersize',30)

- plot3(x(1),x(2),1.1,'.','markersize',30,'color',[1 0 0])

- hold off

- view(2)

- title('三分类')

- xlabel('X(1,:) and x(1)')

- ylabel('X(2,:) and x(2)')

संभाव्यतावादी तंत्रिकाजालम् (PNN) एकं कृत्रिमं तंत्रिकाजालं प्रतिरूपवर्गीकरणार्थं प्रयुक्तम् अस्ति । इदं बेयस्-प्रमेयस्य गाउसीयमिश्रणप्रतिरूपस्य च आधारेण भवति, तस्य उपयोगः विविधप्रकारस्य आँकडानां संसाधनार्थं भवति, यत्र निरन्तरदत्तांशः, असततदत्तांशः च सन्ति वर्गीकरणसमस्यानां निवारणे पारम्परिक-तंत्रिकाजालस्य अपेक्षया पीएनएन अधिकं लचीलं भवति, तथा च अधिकसटीकता सामान्यीकरणक्षमता च अस्ति ।

पीएनएन इत्यस्य मूलभूतकार्यसिद्धान्तः अस्ति यत् नमूनासमूहे निवेशदत्तांशसमूहस्य प्रत्येकस्य नमूनायाश्च समानतायाः गणना, समानतायाः आधारेण निवेशदत्तांशस्य वर्गीकरणं च पीएनएन इत्यत्र चत्वारि स्तराः सन्ति : इनपुट् लेयर, पैटर्न् लेयर, कम्पटीशन लेयर, आउटपुट् लेयर च । निवेशदत्तांशः प्रथमं निवेशस्तरद्वारा प्रतिरूपस्तरं प्रति प्रसारितः भवति, ततः प्रतियोगितास्तरद्वारा समानतायाः गणना भवति, अन्ते च समानतायाः अनुसारं निर्गमस्तरस्य वर्गीकरणं भवति

Matlab मध्ये, भवान् PNN वर्गीकरणं कार्यान्वितुं प्रासंगिकसाधनपेटिकानां उपयोगं कर्तुं शक्नोति अथवा स्वयमेव प्रोग्रामं कर्तुं शक्नोति । प्रथमं भवद्भिः प्रशिक्षणदत्तांशसमूहः परीक्षणदत्तांशसमूहः च सज्जीकर्तुं आवश्यकः, ततः प्रशिक्षणदत्तांशसमूहस्य माध्यमेन PNN मॉडलं प्रशिक्षितव्यः । प्रशिक्षणं समाप्तं कृत्वा परीक्षणदत्तांशसमूहस्य उपयोगः पीएनएन-वर्गीकरणप्रदर्शनस्य मूल्याङ्कनार्थं भविष्यवाणीं च कर्तुं शक्यते ।

समग्रतया पीएनएन विविधवर्गीकरणसमस्यानां कृते उपयुक्ता शक्तिशालिनी वर्गीकरणपद्धतिः अस्ति । व्यावहारिकप्रयोगेषु वर्गीकरणप्रदर्शने सुधारं कर्तुं विशिष्टसमस्यानां अनुसारं समुचितविशेषतानां, आदर्शमापदण्डानां च चयनं कर्तुं शक्यते । Matlab इत्येतत् साधनानां, कार्यसमर्थनस्य च धनं प्रदाति, येन PNN इत्यस्य कार्यान्वयनम्, प्रयोक्तुं च सुलभं भवति ।

- %% 基于概率神经网络(PNN)的分类(matlab)

- %此处有三个二元输入向量 X 和它们相关联的类 Tc。

- %创建 y 概率神经网络,对这些向量正确分类。

- %重要函数:NEWPNN 和 SIM 函数

- %% 数据集及显示

- X = [1 2; 2 2; 1 1]';

- Tc = [1 2 3];

- figure(1)

- plot(X(1,:),X(2,:),'.','markersize',30)

- for i = 1:3, text(X(1,i)+0.1,X(2,i),sprintf('class %g',Tc(i))), end

- axis([0 3 0 3])

- title('三个二元向量及分类')

- xlabel('X(1,:)')

- ylabel('X(2,:)')

- %% 基于设计输入向量测试网络

- %将目标类索引 Tc 转换为向量 T

- %用 NEWPNN 设计 y 概率神经网络

- % SPREAD 值 1,因为这是输入向量之间的 y 典型距离。

- T = ind2vec(Tc);

- spread = 1;

- net = newpnn(X,T,spread);

- %测试网络

- %基于输入向量测试网络。通过对网络进行仿真并将其向量输出转换为索引来实现目的。

- Y = net(X);

- Yc = vec2ind(Y);

- figure(2)

- plot(X(1,:),X(2,:),'.','markersize',30)

- axis([0 3 0 3])

- for i = 1:3,text(X(1,i)+0.1,X(2,i),sprintf('class %g',Yc(i))),end

- title('测试网络')

- xlabel('X(1,:)')

- ylabel('X(2,:)')

- %数据测试

- x = [2; 1.5];

- y = net(x);

- ac = vec2ind(y);

- hold on

- figure(3)

- plot(x(1),x(2),'.','markersize',30,'color',[1 0 0])

- text(x(1)+0.1,x(2),sprintf('class %g',ac))

- hold off

- title('新数据分类')

- xlabel('X(1,:) and x(1)')

- ylabel('X(2,:) and x(2)')

- %% 概率神经网络将输入空间分为三个类。

- x1 = 0:.05:3;

- x2 = x1;

- [X1,X2] = meshgrid(x1,x2);

- xx = [X1(:) X2(:)]';

- yy = net(xx);

- yy = full(yy);

- m = mesh(X1,X2,reshape(yy(1,:),length(x1),length(x2)));

- m.FaceColor = [0 0.5 1];

- m.LineStyle = 'none';

- hold on

- m = mesh(X1,X2,reshape(yy(2,:),length(x1),length(x2)));

- m.FaceColor = [0 1.0 0.5];

- m.LineStyle = 'none';

- m = mesh(X1,X2,reshape(yy(3,:),length(x1),length(x2)));

- m.FaceColor = [0.5 0 1];

- m.LineStyle = 'none';

- plot3(X(1,:),X(2,:),[1 1 1]+0.1,'.','markersize',30)

- plot3(x(1),x(2),1.1,'.','markersize',30,'color',[1 0 0])

- hold off

- view(2)

- title('三分类')

- xlabel('X(1,:) and x(1)')

- ylabel('X(2,:) and x(2)')

-

-

-