le mie informazioni di contatto

Posta[email protected]

2024-07-08

한어Русский языкEnglishFrançaisIndonesianSanskrit日本語DeutschPortuguêsΕλληνικάespañolItalianoSuomalainenLatina

Questa settimana ho letto un articolo intitolato Chasing Fairness in Graphs: A GNN Architecture Perspective. Questo articolo propone uno schema di passaggio di messaggi equo (FMP) guidato da un quadro di ottimizzazione unificato della rete neurale del grafo (GNN), con l'obiettivo di migliorare l'equità dell'elaborazione dei dati del grafo. Questo approccio si ottiene attraverso due passaggi fondamentali: prima aggregando i dati del grafico e poi perseguendo esplicitamente la rappresentazione del centro di ciascuna popolazione statistica per ridurre le distorsioni. Questo metodo costruisce un problema di ottimizzazione che considera sia l'equità che la fluidità dei dati e utilizza le tecniche del coniugato di Fenchel e della discesa del gradiente combinate con le caratteristiche della funzione softmax per risolverlo in modo efficiente, generando una rappresentazione del nodo che sia allo stesso tempo corretta e informativa. Questo schema è direttamente integrato in GNN per migliorare l'equità e l'accuratezza delle attività di classificazione dei nodi senza preelaborazione dei dati. I risultati sperimentali mostrano che su set di dati reali, FMP funziona meglio rispetto a più modelli di base, verificandone pienamente l’efficacia dal punto di vista dell’architettura del modello, dell’efficienza e dell’utilizzo degli attributi sensibili.

Il settimanale di questa settimana decodifica il documento intitolato Chasing Fairness in Graphs: A GNN Architecture Perspective. Questo documento introduce uno schema Fair Message Passing (FMP) guidato da un framework di ottimizzazione unificato di Graph Neural Networks (GNN), che mira a migliorare l'equità nell'elaborazione dei dati grafici. L'FMP raggiunge questo obiettivo attraverso due passaggi fondamentali: innanzitutto, aggregando i dati grafici e poi impegnandosi esplicitamente a rappresentare i centri di vari gruppi statistici per mitigare la distorsione. Questo approccio formula un problema di ottimizzazione che considera sia l'equità che la fluidità dei dati e sfrutta le tecniche di dualità di Fenchel e discesa del gradiente, combinate con le proprietà della funzione softmax, per risolvere in modo efficiente il problema e generare rappresentazioni dei nodi eque e informative. Questo schema è direttamente incorporato nelle GNN per migliorare l'equità e l'accuratezza delle attività di classificazione dei nodi, senza la necessità di pre-elaborazione dei dati. I risultati sperimentali su set di dati reali mostrano che l'FMP supera più modelli di base, convalidandone in modo completo l'efficacia dal punto di vista dell'architettura del modello, dell'efficienza e dell'utilizzo di attributi sensibili.

Argomento: Alla ricerca dell'equità nei grafici: una prospettiva di architettura GNN

Attori: Zhimeng Jiang1, Xiaotian Han1, Chao Fan2, Zirui Liu3, Na Zou4, Ali Mostafavi1, Xia Hu3

pubblicazione:Vol. 38 n. 19: AAAI-24

Collegamento: https://doi.org/10.1609/aaai.v38i19.30115

Questo articolo mira a raggiungere una migliore equità attraverso il nuovo framework GNN, quindi propone di progettare all'interno del framework di ottimizzazione unificato di GNNMessaggistica corretta (FMP) .Vale la pena notare che FMP utilizzaperdita di entropia incrociataPresenta esplicitamente l'uso di attributi sensibili nel passaggio in avanti per le attività di classificazione dei nodi, mentreNon è richiesta alcuna preelaborazione dei dati .In FMP, primo utilizzopolimerizzazioneper sfruttare le informazioni sui vicini, e poiMitigazione dei pregiudizi I passaggi uniscono esplicitamente il centro di rappresentazione del nodo del gruppo di statistiche dei dati. In questo modo, lo schema FMP può aggregare informazioni utili provenienti dai vicini e mitigare i pregiudizi per ottenere una migliore equità e prestazioni di compromesso tra previsioni.Classificazione dei nodiGli esperimenti sull'attività mostrano che il FMP proposto supera più linee di base in termini di equità e accuratezza su tre set di dati del mondo reale.

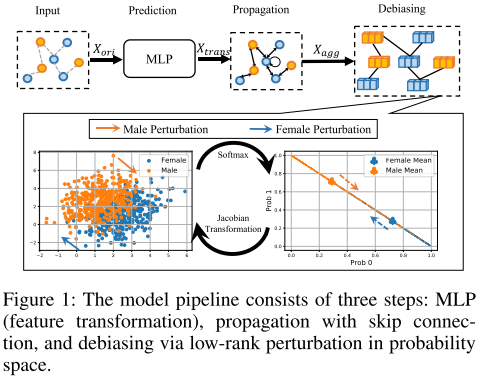

La FMP può ottenere previsioni corrette dal punto di vista della struttura portante del modello. Nello specifico, la messaggistica corretta è formulata come un problema di ottimizzazione per perseguire contemporaneamente la fluidità e la rappresentazione corretta dei nodi. In combinazione con algoritmi di ottimizzazione efficaci ed efficienti, si ottiene un messaggio equo in forma chiusa. Infine, il FMP proposto è integrato in un GNN equo in tre fasi, comprese le fasi di trasformazione, aggregazione e debiasing, come mostrato nella Figura 1. Queste tre fasi utilizzano rispettivamente le caratteristiche del nodo, la topologia del grafico e gli attributi sensibili.

min F λ s 2 tr ( FTT ~ F ) 1 2 ∣ ∣ F − X trans ∣ ∣ F 2 λ f ∣ ∣ Δ s SF ( F ) ∣ ∣ 1 (1) min_{mathbf F}frac{lambda_s}{2}tr(mathbf F^T tilde {mathbf T}mathbf F) frac12||mathbf F-mathbf X_{trans}||^2_F lambda_f||Delta_sSF(mathbf F)||_1 tag{1}Fminimoimo2λSTR(FTT~F) 21∣∣F−XTRUNS∣∣F2 λF∣∣ΔSSan Francisco(F)∣∣1(1)

$tilde L rappresenta la matrice laplaciana normalizzata, rappresenta la matrice laplaciana normalizzata,rappresenta la matrice laplaciana normalizzata,h_s(·)$ e hf ( ⋅ ) h_f(·)HF(⋅) rappresenta obiettivi di fluidità ed equità, X trans ∈ R n × dout X_{trans} in R^{n×d_{out}}XTRUNS∈RN×DllloioT è il trasformato fuori d_{fuori}DllloioTCaratteristiche del nodo dimensione. F ∈ R n × dout F in R^{n×d_{out}}F∈RN×DllloioT sono caratteristiche dei nodi aggregati con la stessa dimensione della matrice.

I primi due termini preservano la somiglianza delle rappresentazioni dei nodi connessi, migliorando così la fluidità del grafico. L'ultimo termine impone una rappresentazione equa del nodo in modo che la probabilità media prevista possa rimanere costante tra i diversi gruppi di attributi sensibili.

I coefficienti di regolarizzazione λs e λf controllano in modo adattivo il compromesso tra fluidità e correttezza del grafico.

hs ( F ) = min F λ s 2 tr ( FTT ~ F ) 1 2 ∣ ∣ F − X trans ∣ ∣ F 2 h_s(mathbf F)=min_{mathbf F}frac{lambda_s}{2}tr(mathbf F^T tilde {mathbf T}mathbf F) frac12||mathbf F-mathbf X_{trans}||^2_FHS(F)=Fminimoimo2λSTR(FTT~F) 21∣∣F−XTRUNS∣∣F2

Obiettivo di fluidità hs(·): le matrici di adiacenza negli schemi di messaggistica grafica esistenti sono normalizzate per migliorare la stabilità numerica e ottenere prestazioni superiori.Da una prospettiva centrata sul bordo, l'obiettivo di livellamento impone che le rappresentazioni dei nodi collegati siano simili perché

tr ( FTT ~ F ) = ∑ ( vi , vj ) ∈ E ∣ ∣ F idi 1 − F idj 1 ∣ ∣ F 2 (2) tr(mathbf F^T tilde {mathbf T}mathbf F)=somma_{(v_i,v_j)in {Epsilon}}||frazione{mathbf F_i}{sqrt {d_i 1}}-frazione{mathbf F_i}{sqrt{d_j 1}}||^2_F tag{2}TR(FTT~F)=(laioooo,laJ)∈E∑∣∣Dioooo 1Fioooo−DJ 1Fioooo∣∣F2(2)

Obiettivo di equità hf(·): L'obiettivo di equità misura la deviazione della rappresentazione del nodo dopo l'aggregazione. Il vettore eventi dell'attributo sensibile Δs rappresenta il gruppo di attributi sensibili e la dimensione del gruppo mediante la somma del segno e del valore assoluto.Il vettore eventi dell'attributo sensibile è

Δs = 1