le mie informazioni di contatto

Posta[email protected]

2024-07-12

한어Русский языкEnglishFrançaisIndonesianSanskrit日本語DeutschPortuguêsΕλληνικάespañolItalianoSuomalainenLatina

Sommario

Oltre un singolo studio randomizzato controllato

Aggregazione di stimatori di differenza nelle medie

X continua e il punteggio di propensione

Una delle estensioni più semplici degli studi randomizzati è la stima non vincolata degli effetti dell’intervento. Qualitativamente parlando, l’illimitatezza è rilevante quando vogliamo stimare un effetto del trattamento che non è casuale, ma è altrettanto casuale una volta controllato un insieme di covariate Xi.

Lo scopo di questa lezione è discutere l'identificazione e la stima degli effetti medi dell'intervento sotto questo presupposto illimitato. Come prima, adotteremo un approccio non parametrico: non assumeremo una buona specificazione di alcun modello parametrico e l’identificazione degli effetti medi del trattamento sarà guidata interamente dalla progettazione (vale a dire, rivendicazioni di indipendenza condizionale rispetto ai potenziali risultati dell’intervento e dei trattamenti).

Definiamo l’effetto causale di un trattamento in base al suo potenziale risultato dell’intervento. Per un intervento binario w∈{0, 1}, definiamo i risultati potenziali Yi(1) e Yi(0), corrispondenti ai risultati che l'i-esimo soggetto sperimenterebbe rispettivamente quando riceve o non riceve l'intervento. Supponiamo che SUTVA,e desideriamo stimare l’effetto medio dell’intervento

Nella prima lezione, abbiamo ipotizzato un incarico di intervento casuale,, e vengono studiati diversi stimatori √n coerenti dell'ATE.

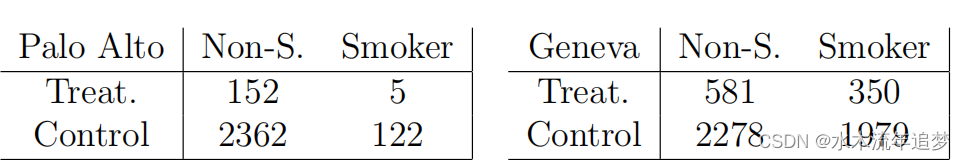

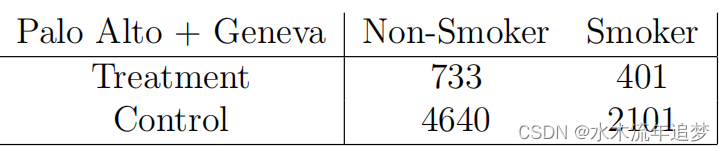

Il modo più semplice per andare oltre un RCT è considerare due RCT. Come esempio concreto, supponiamo di essere interessati a dare agli adolescenti premi in denaro per scoraggiarli dal fumare. Erano idonei a partecipare allo studio il 5% degli adolescenti di Palo Alto, in California, e il 20% degli adolescenti di Ginevra, in Svizzera.

All’interno di ciascuna città abbiamo condotto studi randomizzati e controllati, ed è stato facile vedere che l’intervento ha aiutato. Tuttavia, guardare i dati aggregati può essere fuorviante, facendo sembrare che un intervento causi danni. Questo è un esempio di quello che a volte viene chiamato il paradosso di Simpson: Una volta riuniti i dati, questo non era più un RCT perché i ginevrini avevano sia maggiori probabilità di essere in trattamento che maggiori probabilità di fumare, indipendentemente dal fatto che fossero in trattamento. Per ottenere stime ATE coerenti, è necessario stimare l’effetto dell’intervento separatamente per ciascuna città:

Una volta riuniti i dati, questo non era più un RCT perché i ginevrini avevano sia maggiori probabilità di essere in trattamento che maggiori probabilità di fumare, indipendentemente dal fatto che fossero in trattamento. Per ottenere stime ATE coerenti, è necessario stimare l’effetto dell’intervento separatamente per ciascuna città:

Quali sono le proprietà statistiche di questo stimatore? Come si generalizza questa idea alle x consecutive?

Supponiamo che la covariata Xi assuma valori nello spazio discreto Xi∈X, . Supponiamo inoltre che l'assegnazione del trattamento sia un'assegnazione casuale condizionata a Xi (ovvero, ciascun gruppo ha un RCT definito dal livello x):

Definire l'effetto medio del trattamento all'interno del gruppo come

Quindi, come accennato in precedenza, possiamo stimare l’ATE τ aggregando le stime degli effetti del trattamento a livello di gruppo,

In ,

. Quanto è buona questa stima?Intuitivamente dobbiamo stimare

"parametro", quindi potremmo aspettarci che la varianza sia lineare con p?

Per studiare questa stima, possiamo scriverla come segue. Innanzitutto, per qualsiasi gruppo con covariata x, definisci e(x) come la probabilità di ricevere il trattamento in quel gruppo, , e notato

Inoltre, secondo Senza fare affidamento sulle ipotesi semplificative di w, possiamo ottenere

Successivamente, per lo stimatore dell'insieme, lo faremo definito come

La proporzione delle osservazioni sarà

Definito come il suo valore atteso, possiamo ottenere

Mettendo insieme queste parti otteniamo

Vale la pena notare che la varianza asintotica VAGG non dipende dal numero di gruppi Come vedremo più avanti, questo fatto gioca un ruolo chiave nel fare in modo efficiente inferenze semiparametriche sugli effetti medi dell’intervento negli studi osservazionali.

In precedenza, abbiamo considerato il caso in cui X è discreto e il numero di livelli è limitato, e il trattamento Wi è casuale quanto la condizione di Xi = x nella (2.1). In questo caso, troviamo che l'ATE può ancora essere stimata accuratamente aggregando le stime degli effetti del trattamento all'interno del gruppo e il numero esatto di gruppi |X = p non influisce sull'accuratezza dell'inferenza. Tuttavia, questo risultato non si applica direttamente se X è continuo (o se il numero chi quadrato di Define τ (x) come in .

Per generalizzare la nostra analisi oltre il caso X discreto, non possiamo più semplicemente provare a stimare τ(x) per ogni valore di Per fare ciò, dobbiamo prima generalizzare l’ipotesi che esista un RCT per ciascun gruppo.Formalmente scriviamo semplicemente la stessa cosa

Sebbene ora Xi possa essere una variabile casuale arbitraria, questa affermazione potrebbe dover essere interpretata con maggiore cautela. Da un punto di vista qualitativo, una comprensione della (2.6) è che abbiamo misurato abbastanza covariate per catturare qualsiasi dipendenza tra Wi e il risultato potenziale, in modo che dato Xi, Wi non può "Peep"{Yi(0), Yi(1)} .Chiamiamo questa ipotesiinconfondibilità.

L'ipotesi (2.6) sembra difficile da usare nella pratica perché implica condizioni per variabili casuali continue.Tuttavia, come sottolineano Rosenbaum e Rubin (1983), considerando il punteggio di propensione

Statisticamente, una proprietà chiave del propensity score è che si tratta di un punteggio equilibrato: se vale la (2.6), allora in effetti

Cioè, in realtà è necessario controllare solo e(X) anziché X per eliminare la distorsione associata all'assegnazione non casuale dell'intervento. Possiamo verificare questa affermazione tramite:

L’implicazione della (2.8) è che se possiamo dividere le osservazioni in gruppi con valori (quasi) costanti del propensity score e(x), allora possiamo Le varianti di stimano in modo coerente l'effetto medio dell'intervento.