Mi informacion de contacto

Correo[email protected]

2024-07-12

한어Русский языкEnglishFrançaisIndonesianSanskrit日本語DeutschPortuguêsΕλληνικάespañolItalianoSuomalainenLatina

Tabla de contenido

Más allá de un único ensayo controlado aleatorio

Estimadores de diferencia de medias agregadas

X continua y el puntaje de propensión

Una de las extensiones más simples de los ensayos aleatorios es la estimación ilimitada de los efectos de la intervención. Hablando cualitativamente, la ilimitación es relevante cuando queremos estimar un efecto de tratamiento que no es aleatorio, pero que es casi aleatorio una vez que controlamos por un conjunto de covariables Xi.

El propósito de esta conferencia es discutir la identificación y estimación de los efectos promedio de la intervención bajo este supuesto ilimitado. Como antes, adoptaremos un enfoque no paramétrico: no asumiremos una buena especificación de ningún modelo paramétrico, y la identificación de los efectos promedio del tratamiento estará impulsada enteramente por el diseño (es decir, afirmaciones de independencia condicional con respecto a los resultados y tratamientos potenciales de la intervención).

Definimos el efecto causal de un tratamiento por el resultado potencial de la intervención. Para una intervención binaria w∈{0, 1}, definimos los resultados potenciales Yi(1) y Yi(0), correspondientes a los resultados que el i-ésimo sujeto experimentaría al recibir o no la intervención, respectivamente. Suponemos que SUTVA,y desea estimar el efecto promedio de la intervención

En la primera conferencia, asumimos una asignación de intervención aleatoria,, y se estudian varios estimadores consistentes √n de ATE.

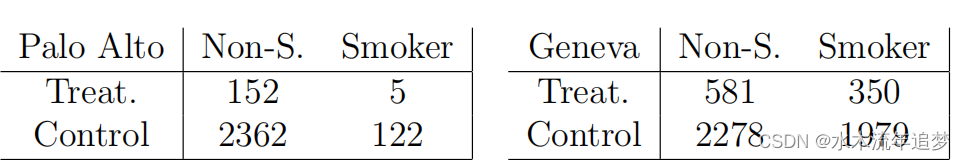

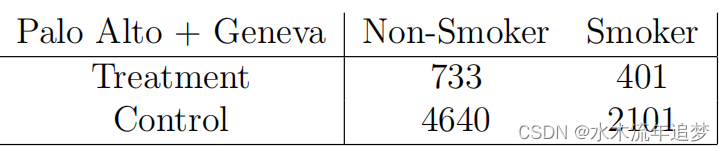

La forma más sencilla de ir más allá de un ECA es considerar dos ECA. Como ejemplo concreto, supongamos que estamos interesados en dar recompensas en efectivo a los adolescentes para disuadirlos de fumar. El cinco por ciento de los adolescentes de Palo Alto, California, y el 20 por ciento de los adolescentes de Ginebra, Suiza, fueron elegibles para participar en el estudio.

Dentro de cada ciudad realizamos estudios controlados aleatorios y, de hecho, fue fácil ver que la intervención ayudó. Sin embargo, observar datos agregados puede resultar engañoso, haciendo que parezca que una intervención causa daño. Este es un ejemplo de lo que a veces se llama la paradoja de Simpson: Una vez que agrupamos los datos, este ya no era un ECA porque los ginebrinos tenían más probabilidades de estar en tratamiento y más probabilidades de fumar, independientemente de si estaban o no en tratamiento. Para obtener estimaciones ATE consistentes, necesitamos estimar el efecto de la intervención por separado para cada ciudad:

Una vez que agrupamos los datos, este ya no era un ECA porque los ginebrinos tenían más probabilidades de estar en tratamiento y más probabilidades de fumar, independientemente de si estaban o no en tratamiento. Para obtener estimaciones ATE consistentes, necesitamos estimar el efecto de la intervención por separado para cada ciudad:

¿Cuáles son las propiedades estadísticas de este estimador? ¿Cómo se generaliza esta idea a x consecutivas?

Supongamos que la covariable Xi toma valores en el espacio discreto Xi∈X, . Supongamos además que la asignación del tratamiento es aleatoria condicionada a Xi (es decir, cada grupo tiene un ECA definido por el nivel x):

Defina el efecto promedio del tratamiento dentro del grupo como

Luego, como se mencionó anteriormente, podemos estimar ATE τ agregando estimaciones del efecto del tratamiento a nivel de grupo,

en ,

. ¿Qué tan buena es esta estimación?Intuitivamente debemos estimar

"parámetro", por lo que podríamos esperar que la varianza sea lineal con p?

Para estudiar esta estimación, podemos escribirla de la siguiente manera. Primero, para cualquier grupo con covariable x, defina e(x) como la probabilidad de recibir tratamiento en ese grupo, , y anotó

Además, según Sin depender de los supuestos simplificadores de w, podemos obtener

A continuación, para el estimador de conjuntos, haremos definido como

La proporción de observaciones será

Definido como su valor esperado, podemos obtener

Juntando estas partes obtenemos

Vale la pena señalar que la varianza asintótica VAGG no depende del número de grupos. Como veremos más adelante, este hecho desempeña un papel clave a la hora de realizar eficientemente inferencias semiparamétricas sobre los efectos promedio de la intervención en estudios observacionales.

En lo anterior, consideramos el caso en el que X es discreto y el número de niveles es limitado, y el tratamiento Wi es tan aleatorio como la condición de Xi = x en (2.1). En este caso, encontramos que ATE aún puede estimarse con precisión agregando estimaciones del efecto del tratamiento dentro del grupo, y el número exacto de grupos |X = p no afecta la precisión de la inferencia. Sin embargo, este resultado no se aplica directamente si X es continuo (o si el número chi-cuadrado de Defina τ (x) como en .

Para generalizar nuestro análisis más allá del caso de X discreto, ya no podemos simplemente intentar estimar τ(x) para cada valor de Para ello, primero necesitamos generalizar la hipótesis de que existe un ECA para cada grupo.Formalmente, simplemente escribimos lo mismo.

Aunque ahora Xi puede ser una variable aleatoria arbitraria, es posible que esta afirmación deba interpretarse con más cautela. Desde una perspectiva cualitativa, una comprensión de (2.6) es que hemos medido suficientes covariables para capturar cualquier dependencia entre Wi y el resultado potencial, de modo que dado Xi, Wi no puede "Peep"{Yi(0), Yi(1)} .A esta hipótesis la llamamosfalta de confusión.

El supuesto (2.6) parece difícil de utilizar en la práctica porque involucra condiciones para variables aleatorias continuas.Sin embargo, como señalan Rosenbaum y Rubin (1983), al considerar la puntuación de propensión

Estadísticamente, una propiedad clave del puntaje de propensión es que es un puntaje equilibrado: si (2.6) se cumple, entonces, de hecho,

Es decir, en realidad sólo es necesario controlar e(X) en lugar de X para eliminar el sesgo asociado con la asignación no aleatoria a la intervención. Podemos verificar esta afirmación mediante:

La implicación de (2.8) es que si podemos dividir las observaciones en grupos con valores (casi) constantes del puntaje de propensión e(x), entonces podemos Las variantes de estiman consistentemente el efecto promedio de la intervención.